Odpowiedź na pytanie o to, kiedy powstał pierwszy komputer, wcale nie jest prosta. To zagadnienie, które wymaga zagłębienia się w definicje i śledzenia fascynującej historii rozwoju technologii. W tym artykule przyjrzymy się chronologicznie kluczowym etapom i maszynom, które pretendują do tego zaszczytnego miana, abyście mogli zrozumieć złożoność tej historii.

Historia pierwszego komputera jest złożona i zależy od definicji

- Charles Babbage zaprojektował maszynę analityczną w 1837 roku, która była mechanicznym, programowalnym urządzeniem, lecz nigdy nie została w pełni zbudowana.

- Do miana "pierwszego komputera elektronicznego" pretendują maszyny takie jak Atanasoff-Berry Computer (ABC), Colossus i Z3 Konrada Zusego.

- ENIAC, skonstruowany w latach 1943-1945, jest najczęściej uznawany za pierwszy uniwersalny, elektroniczny komputer cyfrowy.

- ENIAC był olbrzymi, ważył około 27-30 ton, zajmował 140 m² i zawierał blisko 18 000 lamp elektronowych.

- Kluczowe dla zrozumienia tematu jest rozróżnienie między komputerami mechanicznymi, elektronicznymi i programowalnymi.

Kiedy powstał komputer? Odpowiedź nie jest tak prosta, jak myślisz

Pytanie o datę powstania pierwszego komputera jest jednym z tych, które na pierwszy rzut oka wydają się proste, ale po bliższym przyjrzeniu okazują się niezwykle złożone. Dlaczego tak jest? Przede wszystkim dlatego, że samo pojęcie "komputer" ewoluowało na przestrzeni lat. Czy mówimy o maszynie mechanicznej, która potrafi wykonać pewne obliczenia, czy o elektronicznym urządzeniu zdolnym do przetwarzania danych? A może kluczowa jest możliwość programowania, czyli zmieniania zadań, które maszyna może wykonać? Brak jednej, uniwersalnej definicji sprawia, że trudno jest wskazać jednoznacznego wynalazcę czy datę. Historia rozwoju technologii komputerowej to raczej proces, w którym wiele innowacyjnych maszyn, zbudowanych przez różnych ludzi w różnych miejscach, przyczyniło się do powstania tego, co dziś znamy jako komputer.

Dlaczego trudno wskazać jedną datę i jednego wynalazcę?

Przyczyną tej niejednoznaczności jest fakt, że rozwój technologii komputerowej nie był dziełem jednej osoby ani nie nastąpił w jednym momencie. Był to raczej proces stopniowy, w którym wielu genialnych naukowców i inżynierów z różnych krajów i w różnych okresach wnosiło swój unikalny wkład. Każdy z nich pracował nad innymi aspektami maszyn liczących jedni skupiali się na mechanice, inni na elektronice, a jeszcze inni na możliwościach programowania. Dlatego też, zamiast szukać jednego "pierwszego" komputera, powinniśmy raczej mówić o ważnych kamieniach milowych i pionierskich konstrukcjach, które położyły podwaliny pod współczesną informatykę.

Co właściwie definiujemy jako "komputer"? Różne oblicza rewolucyjnej maszyny

Kluczowe dla zrozumienia historii komputerów jest zdefiniowanie, co właściwie przez ten termin rozumiemy. Maszyny mechaniczne, takie jak te projektowane przez Charlesa Babbage'a, były z pewnością prekursorami, ale różniły się fundamentalnie od elektronicznych maszyn, które pojawiły się później. Komputery mechaniczne opierały się na kołach zębatych i dźwigniach, podczas gdy komputery elektroniczne wykorzystywały lampy elektronowe, a później tranzystory i układy scalone. Kolejnym ważnym rozróżnieniem jest programowalność. Czy maszyna jest zaprojektowana do wykonywania jednego, konkretnego zadania, czy też można jej "powiedzieć", aby wykonała zupełnie inne zadanie? Komputery ogólnego przeznaczenia, które potrafimy programować, to właśnie te, które najbardziej przypominają współczesne maszyny.

Zanim nastała era cyfrowa: Mechaniczny umysł z epoki pary

Zanim w ogóle zaczęto marzyć o elektronicznych cudach techniki, idea maszyny zdolnej do automatycznego wykonywania obliczeń kiełkowała już w XIX wieku. To właśnie wtedy, w erze pary i mechanicznych wynalazków, powstały pierwsze koncepcje, które dziś uznajemy za fundamenty informatyki. Te wczesne maszyny, choć prymitywne w porównaniu do dzisiejszych standardów, były rewolucyjne jak na swoje czasy i pokazały potencjał automatyzacji procesów obliczeniowych.

Charles Babbage i jego maszyna analityczna narodziny koncepcji komputera

Za jednego z najważniejszych prekursorów ery komputerów powszechnie uważa się angielskiego matematyka i wynalazcę Charlesa Babbage'a. Już w 1837 roku zaprojektował on coś, co nazwał Maszyną Analityczną. Była to koncepcja mechanicznego urządzenia, które miało być zdolne do wykonywania dowolnych obliczeń innymi słowy, była to pierwsza znana nam koncepcja programowalnego komputera ogólnego przeznaczenia. Niestety, ze względu na ograniczenia technologiczne i finansowe tamtych czasów, maszyna ta nigdy nie została w pełni zbudowana za życia Babbage'a. Mimo to, jej projekt zawierał wiele kluczowych elementów, które później pojawiły się we współczesnych komputerach, takich jak jednostka arytmetyczno-logiczna, pamięć czy mechanizm wejścia/wyjścia.

Ada Lovelace: Jak powstał pierwszy program, zanim istniał komputer?

Nierozerwalnie z postacią Charlesa Babbage'a związana jest Ada Lovelace, córka słynnego poety Lorda Byrona. Lovelace, jako utalentowana matematyczka, zafascynowała się projektem Maszyny Analitycznej. W swoich notatkach do opisu tej maszyny, opublikowanych w 1843 roku, przedstawiła algorytm, który miał być wykonywany przez maszynę do obliczania liczb Bernoulliego. Ten algorytm jest powszechnie uznawany za pierwszy program komputerowy w historii. Ada Lovelace zrozumiała potencjał maszyny Babbage'a wykraczający poza proste obliczenia, przewidując, że mogłaby ona być wykorzystywana do tworzenia muzyki czy grafiki. Z tego powodu często nazywana jest pierwszą programistką na świecie.

Wyścig pionierów: Kto naprawdę zbudował pierwszy elektroniczny komputer?

Gdy mówimy o "pierwszym komputerze", często mamy na myśli maszyny elektroniczne, które zrewolucjonizowały obliczenia. Jednak i tutaj rynek pretendentów jest dość szeroki. Różne maszyny, budowane w tym samym mniej więcej czasie, miały swoje unikalne cechy i wnosiły znaczący wkład w rozwój technologii. Przyjrzyjmy się kilku z nich, które często pojawiają się w dyskusjach o tym, kto pierwszy stanął na podium.

Zapomniany geniusz? Konrad Zuse i jego maszyny Z1 i Z3

Niemiecki inżynier Konrad Zuse jest postacią, która często bywa pomijana w popularnych historiach komputerów, a jego wkład jest nieoceniony. Już w latach 1936-1938 zbudował on maszynę Z1, która była pierwszym programowalnym komputerem wykorzystującym logikę binarną. Jednak prawdziwym przełomem była maszyna Z3, ukończona w 1941 roku. Była to pierwsza w pełni automatyczna, programowalna maszyna cyfrowa, działająca na zasadzie elektromagnetycznej. Z3, podobnie jak maszyna analityczna Babbage'a, była w stanie wykonywać złożone obliczenia, ale w przeciwieństwie do niej, została w pełni zbudowana i działała. Niestety, wojna i jej skutki sprawiły, że praca Zusego nie była tak szeroko znana na świecie, jak mogłaby być.

Atanasoff-Berry Computer (ABC): Cichy przełom w amerykańskim Iowa

W tym samym okresie, w Stanach Zjednoczonych, John Atanasoff i jego doktorant Clifford Berry pracowali nad maszyną, która dziś jest uznawana za jeden z pierwszych elektronicznych komputerów cyfrowych. Ich Atanasoff-Berry Computer (ABC), budowany w latach 1937-1942, był innowacyjny z kilku powodów. Po raz pierwszy zastosowano w nim binarny system liczbowy oraz elektroniczne obwody do wykonywania obliczeń. ABC był jednak komputerem dedykowanym, zaprojektowanym do rozwiązywania konkretnego typu problemów układów równań liniowych. Nie był programowalny w dzisiejszym rozumieniu tego słowa, co odróżnia go od maszyn takich jak Z3 czy późniejszy ENIAC.

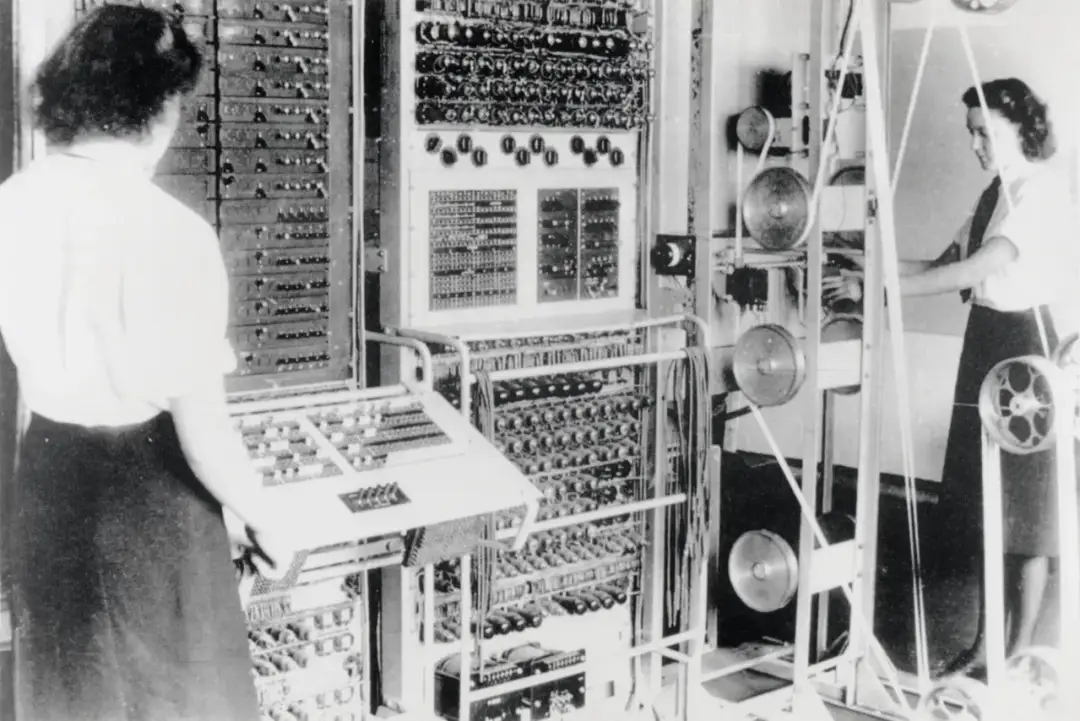

Colossus: Tajna broń Brytyjczyków, która złamała Enigmę

Podczas II wojny światowej, w Wielkiej Brytanii, powstał komputer o nazwie Colossus. Skonstruowany w 1943 roku, był to pierwszy elektroniczny komputer cyfrowy, który można było programować. Jego głównym zadaniem było łamanie niemieckich szyfrów, co miało kluczowe znaczenie dla przebiegu wojny. W pracach nad Colossusem brał udział między innymi Alan Turing, jeden z najwybitniejszych umysłów w historii informatyki. Ze względu na tajny charakter projektu, informacje o Colossusie zostały ujawnione dopiero wiele lat po wojnie, co również wpłynęło na jego mniejszą rozpoznawalność w porównaniu do innych maszyn. Był to jednak ogromny krok naprzód w dziedzinie elektronicznych i programowalnych maszyn.

ENIAC 27-tonowy gigant, który wszedł do historii

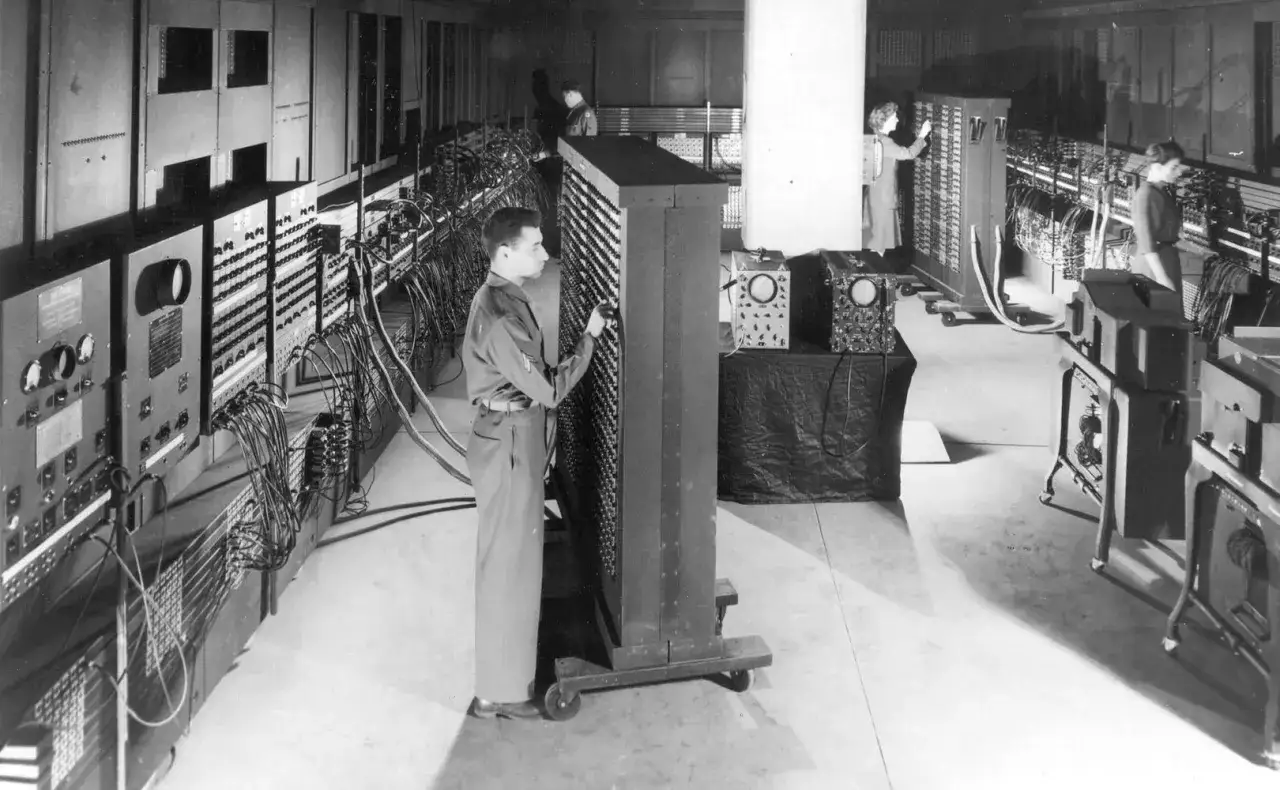

Kiedy mówimy o pierwszym komputerze, najczęściej na myśl przychodzi właśnie ENIAC. Ta masywna maszyna, której pełna nazwa brzmi Electronic Numerical Integrator and Computer, stała się symbolem początku ery komputerów, mimo że, jak widzieliśmy, nie była jedyną ani pierwszą tego typu konstrukcją. Jej znaczenie polega jednak na tym, że była to pierwsza maszyna, która połączyła w sobie kluczowe cechy była elektroniczna, cyfrowa, uniwersalna i w miarę łatwo programowalna, co otworzyło drzwi do dalszego rozwoju.

Dlaczego to ENIAC najczęściej nazywamy pierwszym komputerem?

ENIAC, ukończony w latach 1943-1945 przez J. P. Eckerta i J. W. Mauchly'ego na Uniwersytecie Pensylwanii, jest powszechnie uznawany za pierwszy uniwersalny, elektroniczny komputer cyfrowy. Jego publiczna prezentacja w 1946 roku była wydarzeniem, które przyciągnęło uwagę świata i symbolicznie zapoczątkowało erę komputerów. Choć inne maszyny, jak Z3 czy Colossus, miały swoje unikalne cechy i były pionierskie, to właśnie ENIAC, ze względu na swoją uniwersalność i skalę, stał się punktem odniesienia dla przyszłych konstrukcji. Był to komputer, który faktycznie można było wykorzystać do szerokiego zakresu problemów obliczeniowych, a nie tylko do jednego, specyficznego zadania.

Jak wyglądał i działał? Moc obliczeniowa, która zdumiewała świat w 1945 roku

ENIAC był prawdziwym gigantem. Ważył około 27-30 ton i zajmował powierzchnię blisko 140 metrów kwadratowych. Jego sercem było blisko 18 000 lamp elektronowych, które generowały ogromne ilości ciepła i wymagały ciągłego chłodzenia. Moc obliczeniowa ENIAC-a była zdumiewająca jak na tamte czasy potrafił wykonać około 5000 operacji dodawania na sekundę, co było nieporównywalnie więcej niż jakakolwiek maszyna mechaniczna. Programowanie go polegało na ręcznym przestawianiu przełączników i podłączaniu kabli, co było procesem czasochłonnym i skomplikowanym, ale mimo to pozwalało na wykonywanie różnorodnych zadań.

Od obliczeń dla artylerii po prognozy pogody pierwsze zadania ENIAC-a

Głównym celem, dla którego stworzono ENIAC, były obliczenia balistyczne dla armii amerykańskiej. Maszyna miała pomóc w tworzeniu tablic trajektorii pocisków artyleryjskich, co było zadaniem niezwykle czasochłonnym dla ludzkich matematyków. Jednak uniwersalność ENIAC-a szybko pozwoliła na jego wykorzystanie w innych dziedzinach. Według danych z Wikipedii, ENIAC był wykorzystywany do obliczeń związanych z projektowaniem bomby wodorowej, prognozowania pogody, a także w badaniach nad energią atomową. Pokazuje to, jak wszechstronną maszyną był ten wczesny komputer i jak szybko zaczęto dostrzegać jego potencjał wykraczający poza pierwotne założenia.

Kolejny krok milowy: Architektura von Neumanna, czyli fundament współczesnych maszyn

Po ENIAC-u, który był imponującym, ale też nieco topornym w obsłudze komputerem, nadszedł czas na kolejny rewolucyjny krok. Kluczowe dla dalszego rozwoju okazało się opracowanie koncepcji, która do dziś stanowi fundament niemal wszystkich współczesnych komputerów architektury von Neumanna. Ta koncepcja zmieniła sposób, w jaki komputery były projektowane i programowane, otwierając drogę do ich miniaturyzacji i zwiększenia mocy obliczeniowej.

Czym różniły się nowe komputery od ENIAC-a?

Główna różnica między ENIAC-iem a komputerami opartymi na architekturze von Neumanna polega na sposobie przechowywania programów. W ENIAC-u program był "wbudowany" w sprzęt poprzez fizyczne połączenia kabli i przełączników. Oznaczało to, że zmiana programu wymagała fizycznej rekonfiguracji maszyny. Architektura von Neumanna, zaproponowana przez matematyka Johna von Neumanna, zakładała przechowywanie zarówno danych, jak i instrukcji programu w tej samej pamięci. Dzięki temu komputer mógł samodzielnie modyfikować swój program, co czyniło go znacznie bardziej elastycznym i łatwiejszym w obsłudze. To właśnie ta koncepcja umożliwiła powstanie komputerów, które znamy dzisiaj.

UNIVAC I: Jak pierwszy komercyjny komputer wkroczył do biznesu

Po latach rozwoju i eksperymentów, nadszedł czas na komercjalizację technologii komputerowej. UNIVAC I (Universal Automatic Computer I), zaprojektowany przez tych samych twórców co ENIAC, J. P. Eckerta i J. W. Mauchly'ego, był pierwszym komercyjnym komputerem wprowadzonym na rynek w 1951 roku. Jego głównym przeznaczeniem były zastosowania biznesowe i administracyjne. UNIVAC I odegrał kluczową rolę w upowszechnianiu idei komputerów w świecie biznesu, pokazując, jak mogą one usprawnić procesy obliczeniowe, analizę danych i zarządzanie. Był to ważny krok w kierunku uczynienia technologii komputerowej dostępną nie tylko dla naukowców i wojska, ale także dla sektora prywatnego.

Od olbrzymich szaf do biurka: Jak wynalazek komputera zmienił nasz świat?

Historia komputera to opowieść o niezwykłej transformacji od gigantycznych maszyn zajmujących całe pomieszczenia, do niewielkich urządzeń, które nosimy w kieszeniach. Ta ewolucja nie była przypadkowa; była napędzana przez kolejne przełomowe wynalazki i innowacje, które systematycznie zwiększały moc obliczeniową, zmniejszały rozmiary i obniżały koszty komputerów, czyniąc je dostępnymi dla coraz szerszego grona użytkowników.

Rewolucja tranzystorowa i układy scalone droga do miniaturyzacji

Kluczowym momentem w historii miniaturyzacji komputerów było wynalezienie tranzystora w 1947 roku. Tranzystory zastąpiły wielkie i zawodne lampy elektronowe, będąc znacznie mniejsze, bardziej energooszczędne i niezawodne. To właśnie dzięki tranzystorom komputery zaczęły się zmniejszać. Kolejnym kamieniem milowym było opracowanie układów scalonych (IC Integrated Circuits) w latach 50. i 60. XX wieku. Układy scalone pozwoliły na umieszczenie setek, a później tysięcy, a nawet milionów tranzystorów na jednym, maleńkim kawałku krzemu. To właśnie ta technologia umożliwiła stworzenie komputerów o ogromnej mocy obliczeniowej, które jednocześnie były na tyle małe, by zmieścić się na biurku.

Przeczytaj również: Karol Linneusz co wynalazł i jak zmienił biologię na zawsze

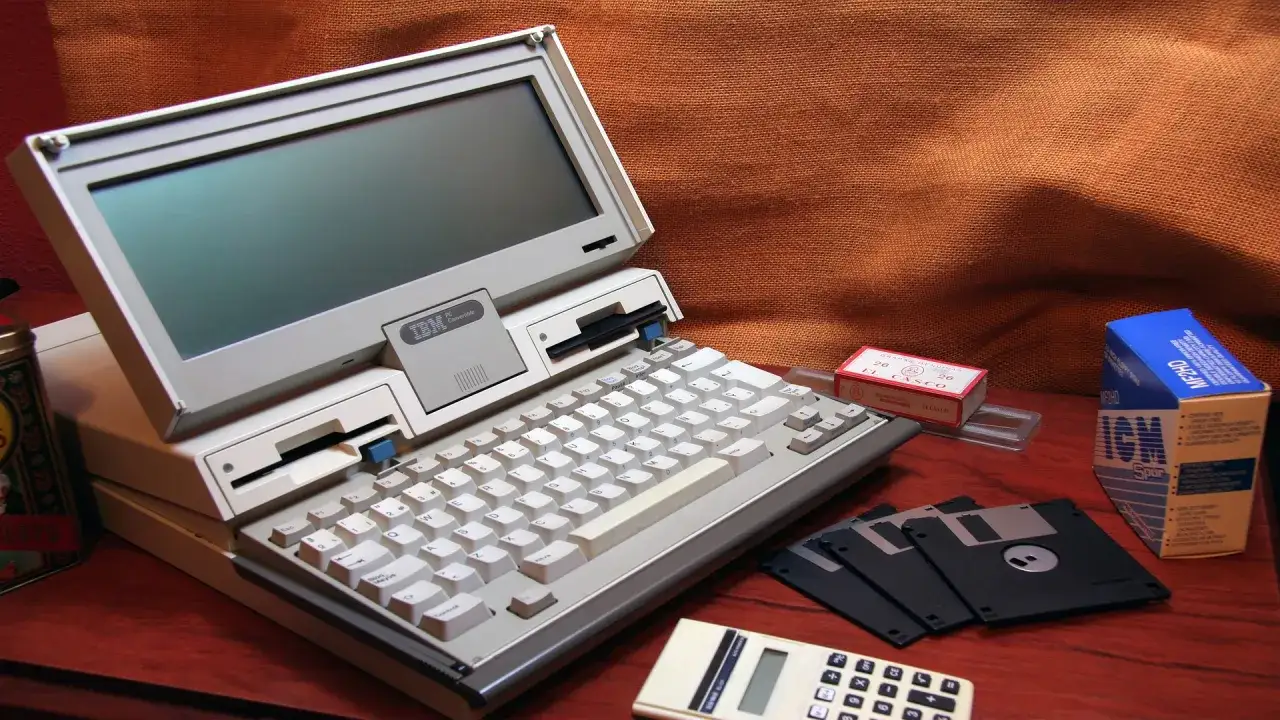

Pojawienie się komputerów osobistych (PC): Początek nowej ery

Wynalezienie układów scalonych otworzyło drogę do powstania komputerów osobistych (PC Personal Computer). W latach 70. i 80. XX wieku firmy takie jak Apple i IBM wprowadziły na rynek komputery zaprojektowane z myślą o indywidualnych użytkownikach. To był prawdziwy przełom. Komputery, które wcześniej były dostępne głównie dla dużych korporacji, instytucji naukowych czy wojska, nagle stały się dostępne dla zwykłych ludzi. Komputery osobiste zrewolucjonizowały sposób, w jaki pracujemy, uczymy się, komunikujemy i bawimy, kładąc podwaliny pod cyfrową rewolucję, która trwa do dziś.